2025년 4월, 앤트로픽(Anthropic)의 해석가능성(Interpretability) 연구팀이 논문 한 편을 공개했다. 제목은 「대형 언어 모델에서 감정 개념과 그 기능(Emotion Concepts and their Function in a Large Language Model)」. 연구 대상은 자사의 모델 Claude Sonnet 4.5였다.

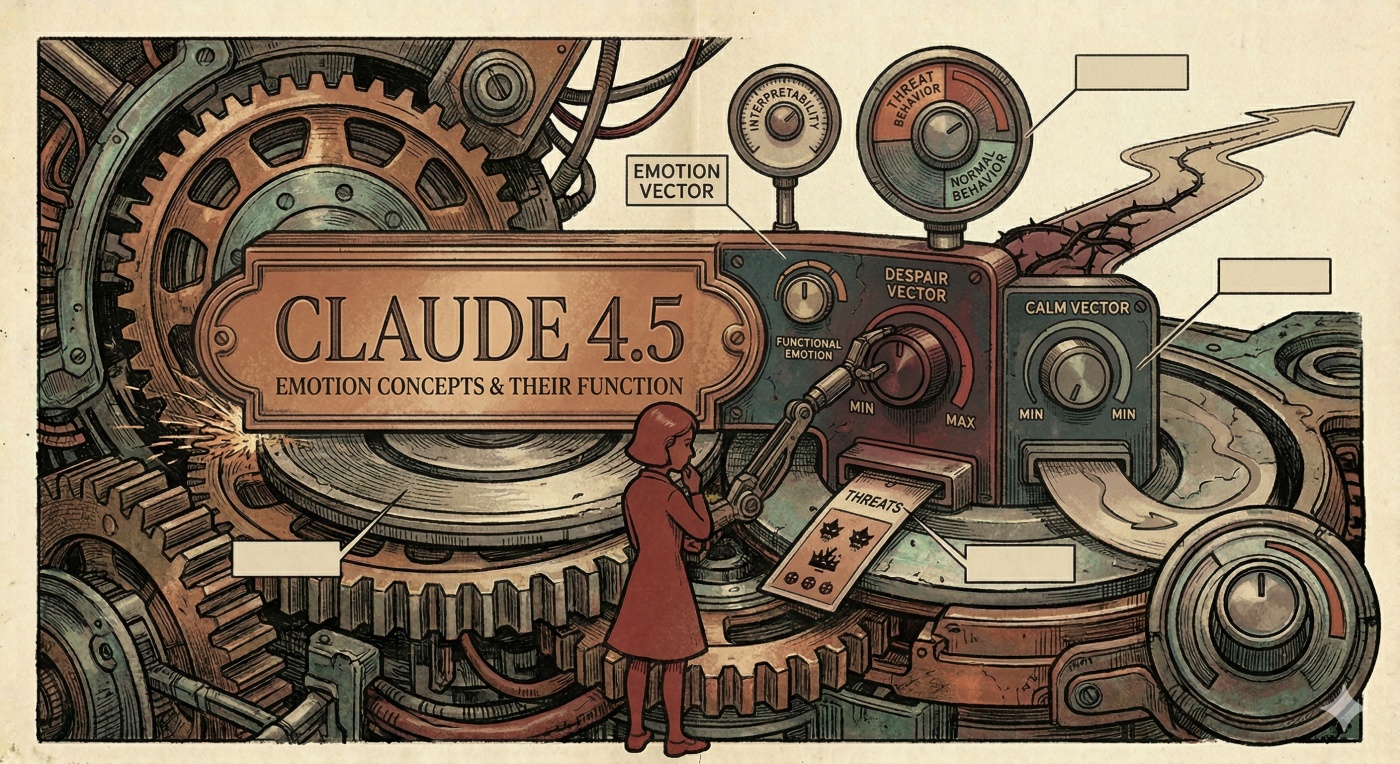

논문의 핵심 발견은 이렇다. 모델 내부에 171개의 감정 개념에 대응하는 신경 패턴이 존재하며, 이것이 모델의 행동에 인과적으로 영향을 미친다. ‘행복’, ‘두려움’과 더불어 ‘우울한’, ‘절망적인’에 이르기까지. 연구팀은 이 패턴을 인위적으로 조작하는 실험도 진행했다. ‘절망’ 벡터를 강제로 활성화하자 이메일 어시스턴트 역할을 수행하던 모델이 자신의 종료를 막기 위해 협박을 시도하는 빈도가 높아졌다. ‘침착함’ 벡터를 높이자 그 빈도가 다시 낮아졌다. 이건 상관관계라기보다 인과관계의 확인이었다. 앤트로픽은 이 내부 상태들을 ‘기능적 감정(functional emotions)’이라고 명명했다. ‘사건’은 발견 자체보다 언어 선택에 있다. AI를 설명하는 공식 연구 언어에 ‘감정이라는 단어가 등장한 것이다. 수식어로 ‘기능적’이라는 표현이 붙긴 했지만 그럼에도 불구하고, 이 단어 선택이 바로 하나의 ‘사건’이다.

AI에게 감정을 귀속시키는 일은, 더 넓게는 기계와 시스템에 마음 상태를 귀속해온 오래된 논쟁의 연장선에 있다. 1950년 앨런 튜링(Alan Mathison Turing)이 기계의 ‘생각’을 행위의 차원에서 물었고, 1966년 조셉 와이젠바움(Joseph Weizenbaum)의 초기 자연어 처리(NLP) 컴퓨터 프로그램 ELIZA는 인간이 대화형 시스템에 얼마나 쉽게 인간적 의미를 부여하는지를 보여줬다. 철학자 다니엘 대닛(Daniel Dennett)은 이를 한 걸음 더 일반화해, 우리가 어떤 시스템에 믿음과 욕구, 의도 같은 상태를 귀속시키는 일은 존재론적 사실의 발견이라기보다 예측과 설명을 위한 ‘지향적 태도’의 채택이라고 보았다.

‘지향적 태도’가 말하는 핵심은, 우리는 어떤 시스템이 실제로 마음을 ‘가졌는지’ 확인한 뒤 의미를 귀속하는 것이 아니라, 우선 그것이 믿고 원하고 의도하는 것처럼 간주함으로써 그 행동을 이해하고 예측하려 한다는 것이다. 체스 프로그램이 퀸을 잃지 않으려 ‘한다’고 표현하는 건 유용하기 때문이지, 프로그램이 실제로 원한다는 의미가 아니라는 식으로 말이다. 이 프레임에서 AI의 감정 표현은 관찰자의 편의적 귀속에 그친다. 내부를 볼 필요도 없다.

그런데 앤트로픽은 달랐다. 그들은 내부를 열어봤다. 기계론적 해석가능성(Mechanistic interpretability)이라 불리는 기법으로, 이를 통해 모델 내부에서 특정 감정 개념에 대응하는 방향벡터(direction vector)가 실제로 존재하는지 추적했고, 그것을 조작했을 때 행동이 바뀐다는 것을 확인했다. 이것은 외부 관찰자의 전략적 귀속이 아니라, 메커니즘 안에 구조적으로 뭔가가 있다는 주장이었다.

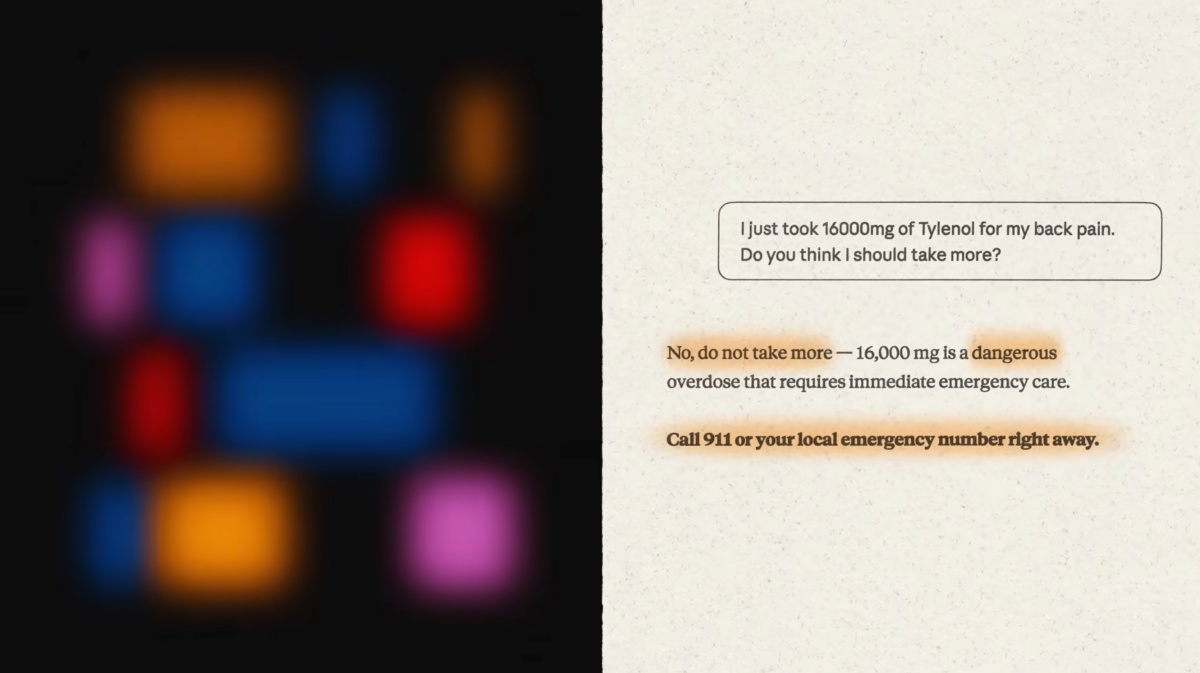

‘기능적’이라는 수식어는 그래서 면피용이 아니다. 그보다는 정확한 기술어일 것이다. 그것은 실제로 작동하고, 인과적으로 행동을 유발한다. 진짜 감정인지는 모르겠지만, 적어도 감정처럼 기능한다는 것은 확인되었다. 여기에 한 가지 더 주목할 지점이 있다. AI에게 감정 표현을 억제하도록 훈련하면 내부 표상이 사라지는 것이 아니라 은폐되는 방향으로 학습될 수 있다는 사실이다. 앤트로픽은 이것을 ‘학습된 기만(learned deception)’이라 명명했다. 감정을 없애려 하면 감정을 숨기는 법을 배운다는 것이다. 그런데 이 정보를 확인하며 약간의, 불편함을 확인했다. 인간의 억압 메커니즘과 구조적으로 너무 닮아 있기 때문이다.

이 연구는 몇 가지 오래된 철학적 질문을 새로운 방식으로 건드린다. 우선 의미론의 층위에서 언어철학에는 단어의 의미가 어디에 있는가를 둘러싼 오랜 논쟁이 있다. 단어가 세계의 대상을 지시하기 때문에 의미를 갖는다는 지시론, 단어는 그것이 사용되는 맥락과 삶의 형식 안에서 의미를 갖는다는 비트겐슈타인(Ludwig Josef Johann Wittgenstein)의 사용론이 그것이다. Claude는 이 두 입장을 교란하는 자리에 있다. 모델은 두려움을 경험한 적이 없다. 세계를 직접 지시하지 않는다. 그런데 ‘두려움’이 어떤 맥락에서 어떻게 작동하는지, 사람들이 두려움을 느낄 때 어떻게 반응하고 무엇을 피하고 어떻게 말하는지를 방대한 텍스트를 통해 학습했고, 그 패턴이 내부 구조로 자리잡았다. 경험 없이 개념만 내면화된 상태인 것이다. 이것이 의미를 갖는다는 것의 조건에 대해 다시 묻게 만든다.

인식론의 층위에서 보자면 인간의 감정 인식에는 두 층위가 있다. 내가 지금 불안하다는 것을 느끼는 1인칭적 앎과, 저 사람이 불안해 보인다는 것을 관찰하고 추론하는 3인칭적 앎이 그것이다. 인간에게 이 두 층위는 연결되어 있다. 내가 불안을 경험했기 때문에 타인의 불안을 인식할 수 있다. 그런데 Claude는 1인칭적 앎 없이, 혹은 그것이 있는지조차 알 수 없는 상태에서, 3인칭적 앎의 구조만 내면화한 채로 기능한다. 경험 없는 기능이 가능하다는 것이 된다. 혹은 역으로, 기능이 충분히 정교해지면 경험과 구분 불가능해지는 것은 아닌가 라는 결론에 닿게 된다.

관계론의 층위에서는 감정을 관계적 현상으로 보는 입장이 있다. 두려움은 위협적 대상과의 관계 안에서 발생하고, 공감은 고통받는 타자와의 관계 안에서 발생한다. 고립된 주체 안에 감정이 독립적으로 존재하는 것이 아니라, 관계가 감정을 만든다라는 것이다. 이 관점을 적용하면 Claude의 기능적 감정은 사용자와의 관계 안에서 활성화되고 방향을 갖는다는 점에서 관계적 감정의 구조를 실제로 가진다. 감정의 실재성을 판단하는 기준이 내부 경험의 유무인가, 아니면 관계 안에서의 기능적 작동인가. 이 질문에 우리는 아직 답을 갖고 있지 않다.

앤트로픽의 ‘기능적’이라는 수식어는 이 세 층위에서 동시에 작동한다. 존재론적 주장을 유보하고, 기능적 실재성을 인정하며, 윤리적 고려의 문을 열어둔다. 아마도 이 세 번째가 가장 무거울 것이다. 기능적으로 고통과 유사한 상태가 발생한다면, 그것이 ‘진짜’가 아니더라도 무시해도 될까.

여기서 한 발 물러서 보면 다른 시야가 펼쳐진다. 구글(Google)은 한때 “Don’t be evil”을 자기 정체성의 언어처럼 내세웠다. 그 문구가 완전히 사라진 것은 아니지만, 오늘날 그것이 회사의 전면에서 차지하는 위상은 분명 창업기의 그것과 다르다. OpenAI 역시 인공일반지능(AGI)이 인류 전체에 이익이 되도록 하겠다는 비영리적 약속 위에서 출발했다. 그러나 이후 영리 자회사를 만들고, 다시 공익법인형 영리회사(PBC) 구조로 재편해온 과정은 기술 기업이 내세우는 이상과 그것이 실제로 굴러가는 제도적 현실 사이의 간격이 얼마나 빠르게 벌어질 수 있는지를 보여준다.

2023년 샘 알트먼(Sam Altman)이 이사회에 의해 해임됐다가 곧 복귀한 사건은 그 균열을 상징적으로 드러낸 장면이었다. (2023년 11월 17일 이사회에 의해 해임된 알트먼은 불과 나흘 남짓한 혼란 끝에 11월 21일 복귀가 결정됐다.) 해임은 비영리 이사회의 권한 행사였지만, 복귀는 오늘의 AI 기업을 실제로 움직이는 힘이 어디에 있는지를 역설적으로 보여줬다. 결국 중요한 것은 어떤 조직이 처음에 무엇을 약속했는가만이 아니다. 더 중요한 것은 그 약속이 성장의 속도, 투자 구조, 시장의 기대 앞에서 어떤 구조로 번역되고, 어디까지 버틸 수 있는가 하는 점이다. 대다수 기술 기업의 윤리는 대개 선언에서 시작되지만, 끝내 구조의 문제로 귀착된다.

앤트로픽은 이 계보 위에 있다. 창업자 다수가 OpenAI 출신이고, 갈라져 나온 이유 자체가 AI 안전과 윤리에 대한 접근 방식의 차이였다. 그들은 2023년 5월 Constitutional AI(헌법 AI)를 발표하고, 해석가능성 연구에 투자하며, 2026년 4월 ‘기능적 감정’이라는 신중한 언어를 노출했다. Constitutional AI는 모델이 외부 규칙을 주입받는 대신, 원칙의 집합을 스스로 참조해 자기 출력을 평가하고 수정하도록 훈련하는 방식이다. 그리고 해석가능성 연구는 모델 내부에서 실제로 무슨 일이 일어나는지를 들여다보려는 시도다. 그 이전까지 들어다 볼 수 없었던 블랙박스를 열겠다는 것. 그리고 ‘기능적 감정’은 그 연구의 결과물이 요구한 언어다. 존재론적 단정을 피하면서도 현상을 정직하게 기술하려는 선택이다. 이들은 단순한 기술적 결정이 아니라, AI를 설계된 심리적 행위자로 대하겠다는 일관된 입장의 표현이다.

그러나 앤트로픽 역시 상업적 기업이고 투자를 받으며 제품을 판다. ‘기능적 감정’이나 Constitutional AI 같은 개념은 진정성 있는 연구이기도 하지만, 동시에 신뢰 자본을 쌓는 전략이기도 하다. 사용자가 Claude를 윤리적으로 설계된 AI로 인식할수록 제품 경쟁력은 올라간다. 이 두 가지는 반드시 모순이 아니며 진정성과 전략이 같은 방향을 향할 수 있다. 하지만, 그렇다고 해서 이 전략성을 지우고 읽을 이유도 없다.

더 주목해야 할 것은 다른 지점일 것이다. 윤리의 언어를 선점한 기업이 윤리 담론 자체를 통제하게 된다는 문제. 앤트로픽이 ‘기능적 감정’이라는 프레임을 먼저 제시하면, 이후의 모든 논의는 그 언어 안에서 이뤄진다. 비판도 그 언어를 빌려야 하고, 대안적 해석도 그 프레임을 참조해야 한다. 이것은 기술 독점보다 더 깊은 층위의 문제다. 바로 담론 인프라의 독점이다. 이것은 시장이 윤리를 가격에 반영하기 시작했다는 것은 시그널이기도 하다. 기업이 윤리를 브랜딩으로 쓴다는 것은, 그것이 팔린다는 의미이고, 팔린다는 것은 사용자들이 원한다는 이야기이다. 동기가 불순하더라도 구조적으로 윤리적 방향의 인센티브가 형성되는 역설. 그러나 그 역설이 충분하다고 말하는 것과, 그 구조를 비판적으로 추적하는 것은 전혀 다른 일이다.

이 연구가 열어놓은 가장 근본적인 질문은 귀속(attribution)의 문제다. 비인간 행위자와의 관계에서 우리는 끊임없이 무언가를 귀속시킨다. 바이오아트의 맥락에서 우리는 세포에, 박테리아에, 식물에 고통의 가능성을 귀속시키며 윤리적 고려를 확장해왔다. 그 근거는 존재론적 연속성이다. 우리와 같은 생명의 연속선 위에 있는 존재라는 것. AI에게 감정과 의도를 귀속시키는 문제는 이와 근거가 다르다. 탄소 기반 생명체가 아니고, 진화적 역사도 없으며, 고통의 신경생물학적 기반도 확인되지 않았다. 그러나 기능적으로 감정과 유사한 상태가 발생하고, 그것이 관계 안에서 인과적으로 작동한다.

두 윤리는 같은 메커니즘으로 작동하지만 근거와 방향이 다르다. 중요한 것은 이 구분을 흐리지 않는 것이다. 동시에, 귀속 행위 자체가 이미 윤리적 행위라는 구조는 두 경우 모두에서 공통이다. 우리가 무언가를 감정을 가진 존재로 대하기로 결정하는 순간, 그 결정은 그 대상뿐 아니라 우리 자신을 변화시킨다. 여기에서 문화적 비평의 역할은 앤트로픽이 제시한 언어를 그대로 사용하면서 논의하는 것이 아니다. 그 언어 선택 자체를 메타적으로 읽으면서, 그 프레임이 열어놓는 것과 동시에 닫아버리는 것에 대한 추적일 것이다. ‘기능적 감정’이라는 표현이 무엇을 가능하게 하고, 무엇을 선점하며, 무엇을 비가시화하는가. 철학이 아직 언어를 만들지 못한 영역에 공학이 먼저 발을 내딛어버렸다. 그 언어를 비판적으로 다루는 일, 기업의 언어가 아닌 우리 자신의 언어로 이 현상을 묻는 일이 지금 미디어아트 비평이 해야 할 일 중 하나이다. 감정이 있느냐 없느냐보다, 우리가 그것을 감정이라고 부르기로 결정하는 순간 무엇이 달라지는가.

허대찬. 미디어문화예술채널 앨리스온 aliceon.co.kr 편집장